Jag förstår, ja det blir alltid några saker man måste hålla reda på per maskin om man installerar om vid behov (men behåller /home). Särskilt som dina 9 maskiner alla har olika uppgifter (som jag förstår det), så finns det inte så mycket redundans i hur de ska konfas. Medan Linux är utmärkt designat för att köra ett och samma system på 10-100 datorer, så är det mindre anpassat till flera olika system som alla är olika på något sätt. Det finns som sagt knep för att göra script som installerar ett system med anpassningar inbyggda, men alla dessa kräver nog att man tänker ut i förväg vad man vill ha, och du vill nog hellre kunna experimentera tills du är nöjd och "frysa" konfen då.

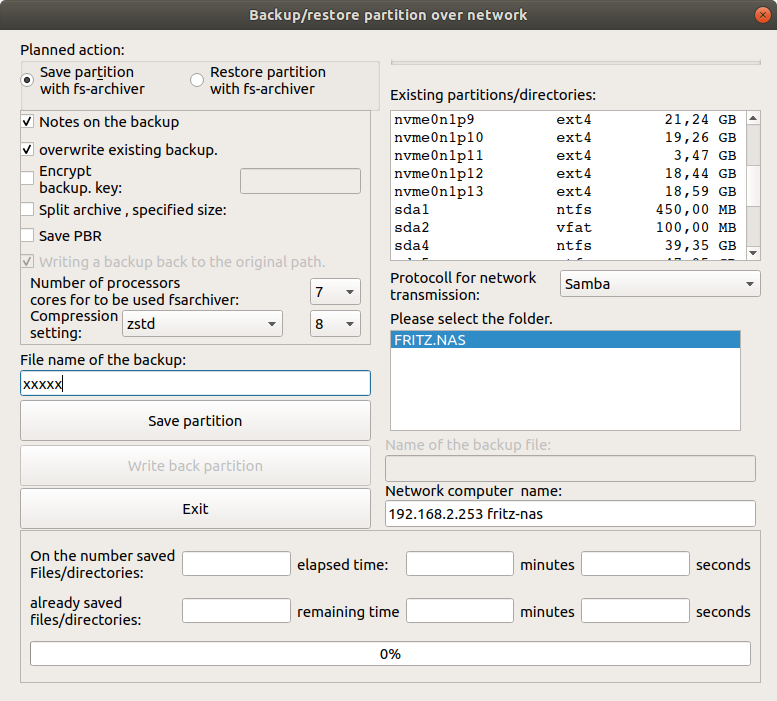

Jag kan definitivt se fördelar med en image-modell som du efterfrågar, även om jag nog skulle säga att fördelarna är mycket mindre än de varit med Windows. Jag vet inte om det finns program anpassade för clone/restore så smidigt som du efterfrågar (men jag har inte koll på allt det som andra tipsat om i tråden), men det finns absolut sätt som kan funka om man accepterar lite CLI-excercis. Du kan som sagt ha systemet förutom /home på en partition, och det är lätt att klona den (partitionen med allt utom /home) med programmet dd (nämnt i första inlägget i tråden).

Här är lite om hur du komprimerar tomma utrymmen "on the fly" med dd: https://serverfault.com/questions/439128/dd-on-entire-disk-bu... - för ssder bör du dock hoppa över steget att fylla tomma utrymmen med 0:or. Det kräver en del inläsning och testande som du förstår, men det kanske det är värt om du hellre klonar än installerar om

Du nämner PXE-boot och att du har en server, så det låter som att du redan har smidiga vägar för att lagra images och att boota ett tillfälligt system för att göra själva kloningen. Så testa gärna och låt oss veta om du får till en metod som funkar för dig

Till frågan om releasecykler och hur ofta du måste klona. Du gissar nog helt rätt att det borde fungera sämre för rolling release, åtminstone de som verkligen rullar och inte har versioner, typ Gentoo och Arch. Min erfarenhet med Gentoo (från ca 10 år sedan) är att om uppdateringarna halkat efter i några månader, så har ekosystemet ändrats så mycket så att en enkel uppdatering till nyaste mjukvaran kommer att misslyckas i något steg. Medan om man uppdaterar en gång i veckan så kan det rulla på smidigt i många år. M.a.o., för rolling-release så behöver du nog göra en ny klon av systemet ganska ofta, kanske så ofta som 1-2 ggr / månad.

Distar som har fixa releases, t.ex. ubuntu, borde det räcka med att klona efter varje ny release, även för LTS. Dvs du uppgraderar med systemets egen funktion för detta (behöver normalt inte installera om), och sen klonar när du sett att allt funkar.

Många distar har dels en releasecykel med förutsägbara versionshopp, men rullar ändå mellan versionerna. Ubuntu och Mint är smidig på så vis att de både har releases, och uppdaterar ganska aggressivt mellan releases så att man har de senaste features ganska snart efter att de lämnat development-brancherna. Samtidigt vet jag när nästa release kommer, och stora ändringar sker bara i samband med större releases. Dessa borde också funka att klona tycker jag, men...

Brasklapp: vi vet att det går bra att uppdatera en t.ex. LTS från 2016 till 2020 års mjukvara, eftersom det är vad vi gör om vi installerar den från scratch. Men det finns en risk att om systemet fylls med program efter användarens tycke 2016, och man försöker uppdatera allt först 2020, så kan någon oupptäckt bugg göra att någon uppdatering misslyckas. Gissningsvis går det att hantera med ominstallation av berört paket, men kanske värt att kolla folks erfarenheter av long-shot-uppdateringar om detta är ett problem